Avec une communauté croissante de plus de 3 milliards de joueuses et de joueurs dans le monde, continuer à investir dans la confiance et la sécurité est essentiel pour favoriser un environnement en ligne sûr et inclusif. Vous protéger contre les différents dangers fait évidemment partie intégrante du rôle de l’équipe Xbox en charge de la sécurité, mais aussi du travail que nous accomplissons. Souvent, les joueuses et les joueurs ne voient pas ou ne connaissent pas toutes les mesures de modération du contenu qui fonctionnent en arrière-plan et qui contribuent à rendre leur expérience plus sûre et plus accueillante. Nous publions aujourd’hui le deuxième rapport de transparence Xbox, qui détaille les efforts continus que nous déployons pour mieux vous protéger, et qui illustre nos mesures de sécurité à l’œuvre.

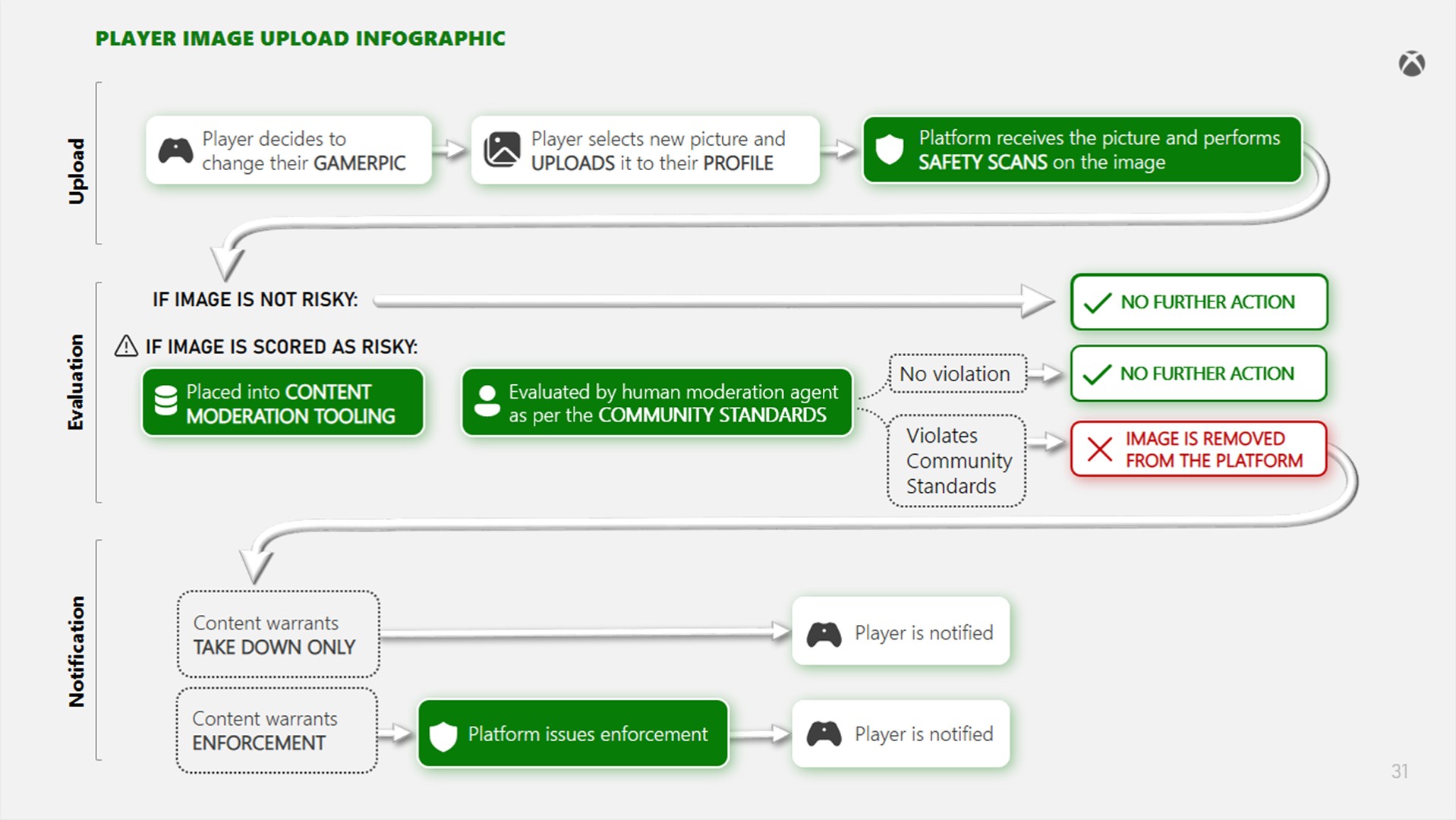

Notre vision de la sécurité arbore de multiples facettes, comme on peut le voir avec nos efforts de modération proactifs et réactifs, les Normes de la Communauté, les contrôles parentaux et familiaux tels que l’application Xbox Family Settings, et notre travail continu avec les partenaires de l’industrie et les régulateurs. Nos investissements essentiels dans la modération de contenu combinent l’IA et les technologies humaines pour identifier et filtrer le contenu avant qu’il n’atteigne les joueuses et les joueurs et n’ait un impact sur eux. Nous utilisons une série de mesures qui nous donnent l’échelle, la vitesse et l’ampleur nécessaires pour suivre les interactions et les activités croissantes de nos joueuses et joueurs. Comme indiqué dans le rapport de transparence, 80 % (8,08 millions) du nombre total d’infractions empêchées au cours de cette période l’ont été grâce à nos efforts de modération proactifs. Les données montrent l’impact de cette approche.

Nos outils évoluent en même temps que les besoins des joueuses et des joueurs. Votre sécurité est une priorité absolue : pour que les expériences en ligne soient toujours plus sûres, nous continuerons à investir dans l’innovation, à travailler en étroite collaboration avec les partenaires du secteur et les régulateurs, et à recueillir les retours de la communauté. Nous sommes impatients de pouvoir vous en dire plus à ce sujet.

Quelques éléments clés de notre rapport :

- Les mesures proactives sont essentielles pour une expérience plus sûre. Au cours de cette période, 80 % des actions prises à l’encontre des infractions ont été le résultat de nos efforts de modération proactive. Cette approche comprend des mesures à la fois automatisées et humaines, qui filtrent les contenus avant qu’ils n’atteignent les joueuses et les joueurs. Les outils automatisés, tels que Community Sift, travaillent sur les textes, les vidéos et les images et détectent les contenus offensants en quelques millisecondes. L’année dernière, Community Sift a évalué 20 milliards d’interactions humaines sur Xbox. Des mesures proactives ont également permis de détecter et de lutter contre 100 % des cas de vols de compte, de piratage, d’hameçonnage et de comptes faux ou responsables de triche.

- Une attention accrue vis à vis des contenus inappropriés. Nous comprenons que les besoins de nos joueuses et joueurs sont en constante évolution et nous continuons à écouter vos retours sur ce qui est ou n’est pas acceptable sur la plateforme, conformément à nos Normes de la Communauté. Au cours de la dernière période en date, nous avons élargi notre définition du contenu vulgaire pour y inclure les gestes offensants, le contenu sexualisé et l’humour grossier. Ce type de contenu est généralement considéré comme déplaisant et inapproprié, ce qui nuit à l’expérience de nombreuses personnes. Ce changement de politique, associé à l’amélioration de nos classificateurs d’images, a entraîné une augmentation de 450 % des sanctions pour les contenus vulgaires et 90,2 % de ces derniersont fait l’objet d’une modération proactive. Ces sanctions se limitent souvent à la suppression du contenu inapproprié, ce qui se traduit par une augmentation de 390 % des sanctions portant uniquement sur le contenu au cours de cette période.

- L’accent continue d’être mis sur les faux comptes. Notre modération proactive, qui a augmenté de 16,5 fois par rapport à la même période l’année dernière, nous permet de repérer les contenus et les comportements négatifs avant qu’ils n’atteignent les joueuses et les joueurs. L’équipe Xbox en charge de la sécurité a émis plus de 7,51 millions de sanctions proactives contre des faux comptes, ce qui représente 74 % du total des sanctions pour la période considérée (contre 57 % pour la période précédente). Les faux comptes sont généralement des comptes automatisés ou créés par des robots, créent des conditions de jeu inégales et peuvent nuire à l’expérience. Nous continuons à investir dans notre technologie et à l’améliorer afin que les joueuses et les joueurs puissent vivre des expériences sûres, positives et attrayantes.

Notre équipe continue de travailler en étroite collaboration avec des partenaires clés de l’industrie, afin de collaborer à notre approche de la sécurité, notamment en renforçant la formation et en améliorant nos mesures de sécurité pour dépasser les normes :

- l’application Xbox Family Settings, qui donne aux parents et aux tuteurs légaux un moyen pratique de gérer l’expérience des enfants sur Xbox, ainsi qu’une série de moyens de contrôles, détaillés dans notre Xbox Family Hub.

Ensemble, nous créons une communauté où chacun·e peut s’amuser. Chaque personne, du néophyte au vétéran, joue un rôle dans la construction d’une communauté plus positive et plus accueillante pour toutes et tous. Vos retours et vos signalements nous aident à améliorer nos fonctionnalités dédiées à la sécurité. Si vous voyez quelque chose d’inapproprié, signalez-le, nous ne pourrions rien faire sans vous !

Enfin, voici quelques ressources supplémentaires :

- Donnez-nous vos retours via le programme Xbox Insider ou sur le site du Support Xbox.

- Consultez les Normes de la Communauté Xbox

- Apprenez-en plus sur l’application Xbox Family Settings dans cette vidéo et téléchargez l’application une fois que vous aurez compris son fonctionnement.

- Apprenez-en plus sur la vie privée et la sécurité en ligne.

- N’oubliez pas comment signaler un profil et soumettre un examen de cas.

- Ressources dédiées àMinecraft Education :

- Besoin d’aide ? Demandez à être appelé, à échanger en ligne et plus encore.